El generador de texto con inteligencia artificial de Open AI objetivamente es imperfecto a la hora de crear una escritura interesante, pero puede crear texto relativamente apropiado para casi cualquier mensaje en cuestión de minutos. Eso ha hecho que muchas personas ya lo estén utilizando para hacer cosas que no deberían.

Y es que cualquier cosa que pueda crear contenido de la nada probablemente puede crear algo peligroso. Es solo cuestión de tiempo.

Hemos recopilado cinco de los usos más cuestionables, que la gente y los ciberdelincuentes ya ha encontrado para la aplicación. Y todo esto sin tener en cuenta que la herramienta se encuentra en fase de pruebas y aún no se ha empezado a utilizar de forma generalizada.

1. Crear malware

Poco han tardado, la gente con malas intenciones en utilizar la tecnología de ChatGPT para recrear cepas de malware y ejecutar ataques de software malicioso, una cadena de infección completa con capacidad para acceder a otros ordenadores en remoto.

2. Hacer trampa en la escuela

OK, esto es malo, pero es más predecible. Una herramienta que puede hacer texto sobre cualquier cosa… literalmente perfecta para un joven que intenta hacer trampa en la escuela. ¿Y a qué alumno no le encanta hacer trampa en la escuela?. En Nueva York ya han prohibido el uso de ChatGTP en todas las escuelas, y es que los alumnos lo utilizaban para redactar trabajos o traducir textos.

Sin embargo, es difícil ver que esta tendencia se desacelera y es probable que la IA se convierta en otra herramienta que los niños pueden usar para aprender, siempre que otras herramientas también con IA sean capaces de detectar si un texto lo ha creado un humano o una máquina.

3. Usarlo para spam en aplicaciones de citas

De acuerdo, tal vez spam no sea la palabra perfecta, pero la gente está usando ChatGPT para entablar conversaciones en Tinder y en otras apps de citas y que estas conversaciones se adapten a los gustos de la otra persona. La gente está dejando que la IA se haga cargo del trabajo preliminar de una conversación. Si bien no es excesivamente malo este uso, es bastante inquietante pensar que podrías estar chateando con una aplicación en lugar de tu posible media naranja.

4. Phishing y estafa

Es más difícil demostrar que esto ya sucedió, pero es lógico pensar que ChatGPT, o herramientas de escritura de IA similares, serían perfectas para el phishing. Los mensajes de phishing a menudo son fáciles de detectar debido a su lenguaje incompleto o con faltas de ortografía, pero con ChatGPT todo eso se puede arreglar. Así lo ha comprobado la empresa de ciberseguridad Check Point, que ha usado la IA para crear correos y código malicioso.

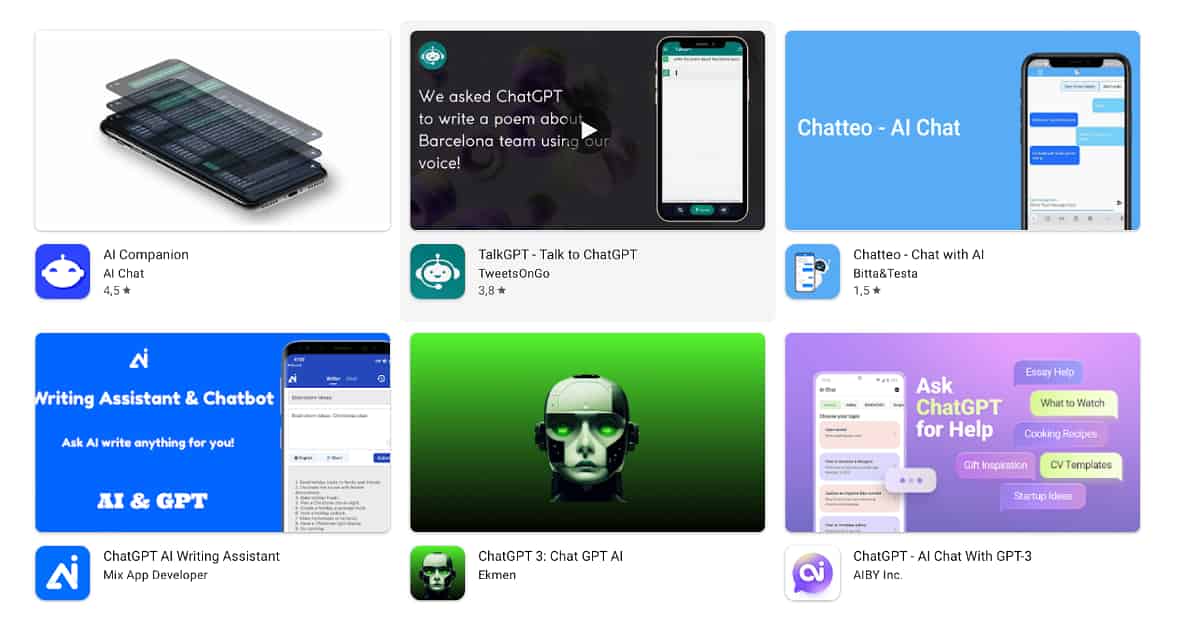

5. Aplicaciones falsas de ChatGPT

Para usar ChatGPT no es necesario descargar ni instalar ningún tipo de app, pero algunos ciberdelincuentes se están aprovechando de la popularidad de esta herramienta para desarrollar apps falsas, llenas de publicidad y que además cobran precios desorbitados por suscribirse y que se puede encontrar en las tiendas de aplicaciones App Store y Google Play.

Muchos usuarios por desconocimiento por las ganas de probar ChatGPT instalan estas aplicaciones en sus dispositivos sin darse cuenta de que les están estafando, como es habitual Google y Apple van a remolque de los delincuentes: cuando detectan estas apps fraudulentas las eliminan, pero mientras tanto son un canal de estafas.

Si quieres interactuar con la IA de Open AI únicamente puedes hacerlo accediendo directamente a la web de Open AI desde el navegador del móvil o desde un ordenador, solo necesitarás registrarse en su web, y nada más, ni registros, ni apps, ni cuotas.